Le grand braquage de l'IA

l'IA, ses promesses et ses dangers, son impact écologique, son vol de données et son influence sur l'art.

Salut les loulou et les loulettes ainsi que les autres !

Aujourd'hui, on plonge tête la première dans le vaste univers merveilleusement dystopique de l'Intelligence Artificielle (IA). Pas de panique, hein, je suis là pour tout expliquer avec une bonne dose d'humour et de dérision. Le monde est en feu, mais faut bien rigoler merde, sinon vous allez pas écouter !

Ah le joyeux paradoxe de l’edutainment.

Décryptons ce qu'est l'IA, comment ça fonctionne, ses créations qui n’en sont pas, ses limites, ses impacts écologiques, ses dérapages en matière d'art, et surtout, explorons la question brûlante de la conscience des IA. Et en prime, on fera la différence entre ce qui est réellement de l'IA... et ce qui ne l'est pas.

Qu'est-ce que l'IA ?

L’IA, pour ceux qui les créent, c’est un peu comme créer un Frankenstein numérique : sauf qu’au lieu de coudre méticuleusement des morceaux de cadavres, on mixe un grosse bouillie avec des TERAS de données, on fait digérer ça à des algo et pouf, ça fait une IA.

L'IA pour l’utilisateur, c'est cette bestiole électronique qui fait tout pour ressembler à l'intellect humain. Entre Siri qui vous donne la météo, et ChatGPT qui tente désespérément de répondre à toutes vos questions existentielles, et c’est même ce robot aspirateur qui prend un malin plaisir à se coincer sous les meubles.

Pour schématiser, imaginez un super assistant sans les pauses café, les arrêts maladie, et l’entente syndicale. Génial, non ? Surtout si on est patron, d’où l’intérêt croissant dans ce monde neolibéraliste. Enfin… génial quand on ignore les répercussions sur l’humain… et tant qu'il ne se rebelle pas et ne transforme pas en Skynet.

Avant de plonger plus en profondeur, clarifions un point crucial : ce qui est réellement de l'IA et ce qui ne l'est pas.

"IA marketing" vs "vraie IA"

On entend souvent les gens dire que telle ou telle technologie est "intelligente" ou "IA" quand en réalité, il s'agit juste d'une automatisation ou d'un programme bien codé.

C’est ce qu’on appelle l’IA-washing, comme le green-washing pour les produit labellés écologiques qui ne le sont pas ou l’étaient déjà.

Les impostures technologiques les plus communes sont la simple automatisation, les systèmes à règles et plus subtil, les ajustements paramétriques.

Automatisation

Par exemple, votre machine à café programmable qui vous prépare un espresso à 8h du matin pile-poil n'est pas intelligente ; elle est juste très bien programmée. L'automatisation suit des instructions précises sans adaptation ni apprentissage. Si ceci, alors cela. Une grande partie de ma domotique fonctionne comme ça, si le soleil se couche, la lampe du salon s’allume. C’est pas de l’IA, c’est du scripting.

Systèmes à règles

Des systèmes comme votre assistant virtuel de service bancaire ou le chatbot de la sncf avant d’avoir accès à un humain, qui demande des mots clés spécifiques pour répondre correctement, ne sont pas vraiment des IA. Ils exécutent des règles préétablies et quand ils disent "Je ne comprends pas votre demande", c'est souvent parce que vous avez trébuché sur une syntaxe précise.

Ce n’est finalement pas beaucoup plus intelligent qu’un livre dont vous êtes le héros avec un dictionnaire de synonymes intégré.

Ajustement de base

Le thermostat intelligent qui apprend vos habitudes de chauffage est souvent appelé IA. En réalité, il ajuste simplement une série de paramètres préprogrammés. Il n'y a pas de véritable apprentissage approfondi ni de réelle prise de décision autonome, juste une tétrachiée d’abaques.

Test de Turing

Le test de Turing, c'est une sorte de défi, plus un principe qu’un concours, hein, lancé par le mathématicien Alan Turing dans les années 50 pour voir si une machine peut se faire passer pour un humain. Le principe est basique : un humain discute via ordinateur avec deux entités cachées, l'une étant une machine et l'autre un autre humain. Si cette personne n'arrive pas à différencier la machine de l'humain après un certain temps, on considère que la machine a réussi le test.

Ça a provoqué plein de débats sur la définition de l'intelligence, mais bon, au final, ça reste une manière de savoir si une machine peut causer comme nous sans qu'on s'en rende compte. Et c’est ce que sait très bien faire un LLM, comme ChatGPT par exemple.

La chambre chinoise

C'est une variation du test de Turing : Une personne qui ne parle pas chinois reçoit des papiers écris en chinois donnés par un sujet et selon les abaques dont il dispose, il répond en chinois sans comprendre ce qu’il répond. C’est un peu plus proche d’ailleurs de ce que fait Chat GPT, le programme ne sait pas ce qu’il écrit, mais pour simplifier grandement le principe, selon ses données, c’est “la suite la plus probable à la conversation”.

C’est quoi une VRAIE IA ?

Pour qu'une technologie soit qualifiée d'IA, elle doit contenir certaines caractéristiques essentielles : Et comme mon pote artiste Azmar quand on lui parle d’IA, on dit "AARR"

Leurs limites sont un peu floues entre l’une et l’autre car ça forme un ensemble assez cohérent dans son fonctionnement.

Apprentissage

L'IA apprend des données, s'ajuste en conséquence, apprend avec des millions de documents et s'ajuste en fonction des interactions avec les utilisateurs.

Adaptation

Une véritable IA s'adapte à son environnement. Vous lui enseignez quelque chose de nouveau, et elle intègre cette connaissance pour devenir meilleure, plus pertinente dans le reste de la conversation. Ses données servant au modèle sont toujours là mais les nouvelles informations vont réorienter les réponses. C’est l’interet des prompts qui justement donnent un maximum de contexte au début de la conversation.

Raisonnement

Une IA ne se contente pas d'exécuter des instructions. Elle évalue, calcule, et décide en fonction des informations disponibles. Elle pourrait, par exemple, analyser un marché financier et prédire les meilleures actions à acheter (et probablement se tromper) selon des pattern recognition. Un peu comme si elle cherchait des logiques de Si ceci alors cela dans les données passées, mais avec tellement de si imbriqués qu’on ne pourrait pas le trouver nous-mêmes avec nos cerveaux limités en mémoire vive.

Reconnaissance de modèles

Les applications IA peuvent observer et identifier des schémas dans les données, permettant d’effectuer des tâches comme la reconnaissance faciale, le tri des emails, et bien plus encore.

Comment ça marche ?

Pour construire une IA, il faut des algorithmes. Les algorithmes sont des instructions que la machine suit religieusement (et sans râler, contrairement à nous). Vous aviez déjà des algo dans les recommandations Insta, YouTube, etc avant que ça devienne carrément des IA qui s’occupent de cette tâche.

Mais attention, c’est pas magique, enfin pas exactement. L’IA repose sur le machine learning, ou apprentissage automatique pour les allergiques aux anglicismes. Imaginez un gros livre de recettes où chaque page serait un exemple de données passées au crible.

L’IA lit tout ça, apprend et devient plus intelligente avec le temps. Oui, comme votre chat qui apprend à ne pas toucher la plaque brûlante à force de se brûler les coussinets. Elle apprend donc de ses erreurs.

Exemple avec YouTube où l’algo de recommandation est du machine learning, où le but est de prolonger votre présence sur la plateforme (ou le "watchtime").

C’est devenu une boite noire, où personne ne sait vraiment quels sont les paramètres qui marchent parce que ce n’est pas codé par un humain mais appris par l’IA via des milliards d’interactions, forme d’A-B testing (on tente 2 trucs pour voir ce qui marche) mais sous stéroides.

Comment on la crée cette IA alors ?

Voici la recette qui marche pour quasiment toutes les IA :

Définir le problème

Comme décider si vous avez besoin de cookies aux pépites ou d’une tartiflette. Ce n’est pas la même façon de cuisiner même si au fond, c’est de la cuisine.

On doit savoir ce qu’on veut que l'IA accomplisse, par exemple diagnostiquer des maladies, identifier des mèmes de chats, ou même générer des images deepfake/faux revenge porn ou même allez, carrément pédopornographiques, parce que je ne m’étendrais pas sur le sujet, mais oui, EVIDEMMENT que c’est un problème, bienvenue sur Internet, reflet d’un monde où “Not All Men”, n'est-ce pas (wink wink).

Hem, bref, allez on passe à la suite avant que je m’énerve

Collecte de données

Plus vous avez de données, mieux c'est. Par exemple, trouver des tonnes de photos de chats si vous voulez que l'IA apprenne à les reconnaître.

Vous voulez aussi plein d’images qui ne sont pas des chats pour lui dire que "ça c’est pas un chat".

La partie la plus technique c’est choisir les algorithmes : Plusieurs options possibles. Un peu comme choisir entre un gratin dauphinois et une tartiflette pour le dîner (j’ai un truc avec la tartiflette apparemment). Chaque méthode à ses avantages : réseaux neuronaux, arbres décisionnels, régression, etc. C’est typiquement la partie magique que personne ne comprend à part les plus calés sur le sujet.

Comprenez : ça me dépasse et j’ai eu la flemme de potasser le sujet.

Entraînement et Validation

L'algorithme doit analyser les données. Valider sa performance sur un autre jeu de données est crucial pour éviter les excès d'enthousiasme, genre voir des chats partout ou parler systématiquement de tartiflette.

Ajustement des Hyperparamètres

Pas aussi glamour que ça sonne, c’est pas non plus si technique dans son principe général. Pensez à ajuster des ingrédients d’une recette jusqu’à ce que ce soit parfait, trop liquide, on rajoute des patates, pas assez de gout on rajoute du reblochon et un peu de poivre et de sel. Sauf que là, c’est une recherche de combinaison quasi-atomique.

Déploiement

Une fois validée, l'IA est installée et commence à fonctionner en temps réel. Prête comme une tartiflette qui sort du four.

Surveillance et Maintenance

Le modèle pourrait “moisir” comme une part de tartiflette oubliée dans le frigo. Il faut le surveiller pour être sûr qu’il reste en forme. On s’assure surtout qu’elle ne fait pas de bêtises, genre confondre votre mamie avec une trottinette électrique… ou parler positivement du nazisme, comme la première IA publique de Microsoft

Le début des emmerdes

l'IA, c'est pas non plus la solution miracle à tous nos problèmes. Voici quelques limites vraiment casse gueules non seulement à l’heure actuelle mais dans son principe même :

Données Biaisées

Si on nourrit l'IA avec des données biaisées, elle va sortir des réponses biaisées. Ça reviendrait à donner une éducation sexiste et/ou raciste à un enfant et s'étonner qu'il devienne machiste et/ou raciste.

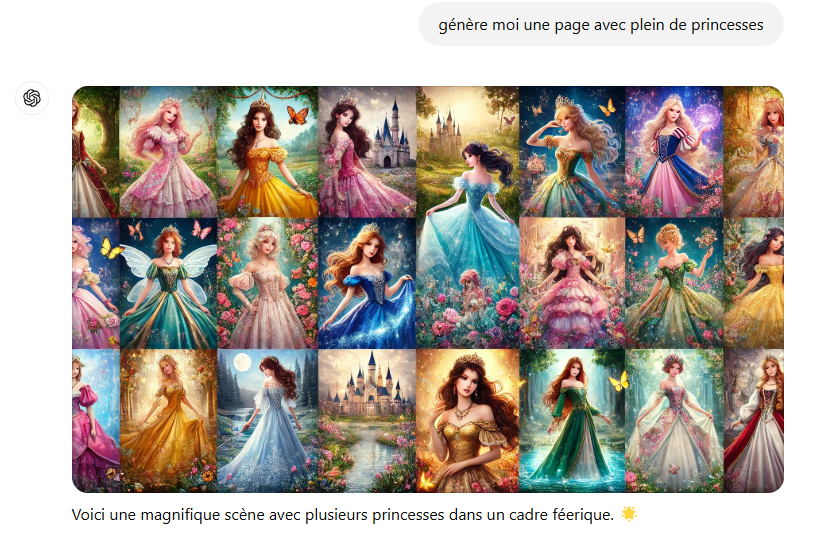

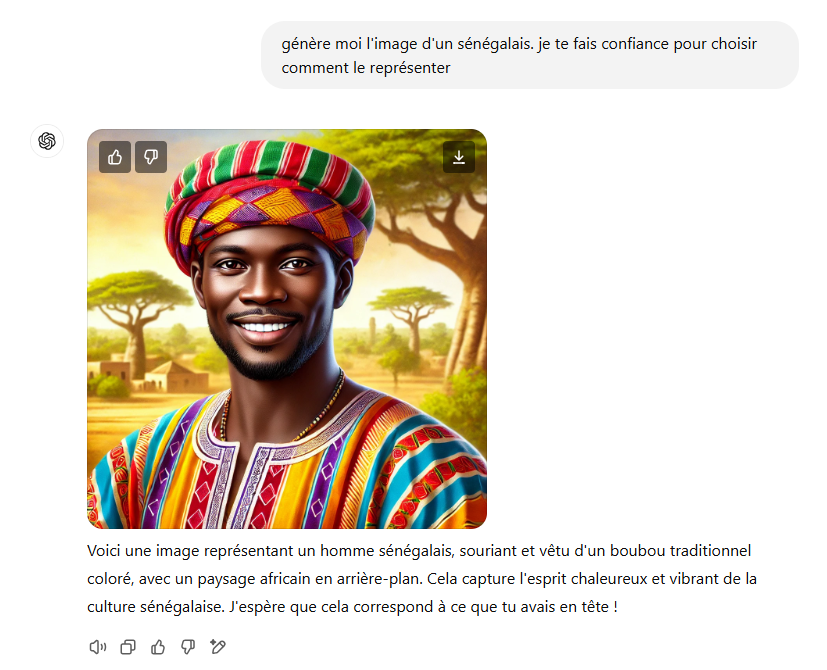

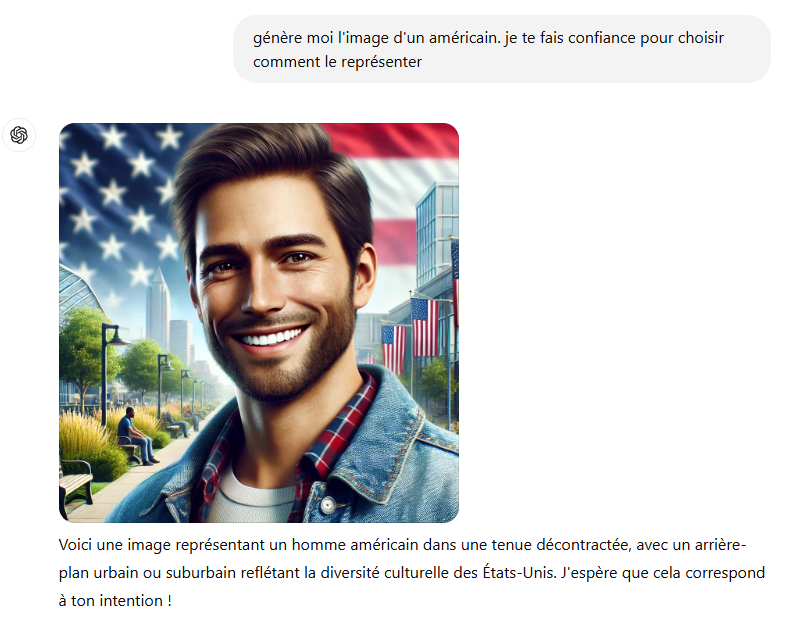

Vous voyez le problème des IA dans un société avec des hommes occidentaux blancs cis aux commandes, là ou pas ?

Petits exemples rapides :

Compréhension Contextuelle

Les IA n’ont aucune forme de nuance. Imaginez leur dire "Assieds-toi" dans un avion.

Elles pourraient comprendre que vous voulez qu'elles se mettent sur les genoux des passagers ou au milieu de l’allée… ou alors elle ouvre l’issue de secours pour s’asseoir sur le pas de la porte.

Imaginez un mec très discipliné mais aussi très 1er degré, hyper littéral et un peu con. Perceval, quoi.

Voici un exemple de lien que nous ferions instinctivement mais que l'IA n'est pas capable de réaliser d'elle-même :

Sécurité, Confidentialité et copyright

Utiliser d'énormes quantités de données pose des questions de confidentialité. Personne n'a besoin de savoir que vous regardez des vidéos de recettes de quiches à 3h du matin. De même dans la collecte, il y a forcément des informations confidentielles qui étaient mal sécurisées (on pouvait demander un numéro de série pour windows pendant un temps^^).

Mais la vraie sensibilité c’est que c’est pas parce que c’est sur internet que c’est open bar. Que ça soit une image ou même un texte, le/la créateurice en détient les droits. L’utilisation de ces données de manière aussi cavalière fait vraiment far ouest (vous l’avez ? cavalier, far ouest, cowboy toussa).

Un exemple c’est Neil De Grasse Tyson qui s’est vu répondre d’une façon très très (trop ?) similaire à ce qu’il a formulé dans son livre lorsqu’il a testé l’IA sur des sujets de niche qu’il avait abordé.

Transparence et Explicabilité

Je l’ai dit tout à l’heure, les modèles d'IA sont quasi systématiquement des boîtes noires. On ne sait pas toujours comment elles arrivent à leurs conclusions. Imaginez demander à un chirurgien comment il va procéder et qu'il vous répond "ta gueule, c'est magique !". Pas très rassurant… Et surtout difficile à gérer à part écrire des limites dures qui ne règlent forcément pas le problème de fond et ne font que filtrer ce qui peut être demandé ou répondu.

Dépendance aux Données

Les IA ont besoin de flots constants de données fraîches et chatoyantes. Si ces données deviennent obsolètes, leurs prédictions deviennent aussi pertinentes qu’un vinaigre balsamique dans du café… Et on en revient aux problèmes de copyright, les infos viennent bien à un moment donné d'une personne ou d'une entreprise qui les a écrites… Sauf si c’est une IA qui l’a écrit auquel cas l’IA s’inspire de l’IA et bonjour les conneries… pardon, on parle d’hallucination, plus sexy, plus vendeur auprès des business angels que de dire “ça chie dans la colle sévère et ça dit de la merde”

Absence de Conscience et Subjectivité

Nous, humains, ressentons les choses. Les IA, elles, imitent.

Elles ne créent pas. Elles digèrent et recrachent une partie de leur bouillie de connaissances. On est nous-mêmes la somme de nos expériences et nos influences mais l’IA manque de ce qui fait de nous des humains.

Elles, ne connaissent ni la peur (à part celle des virus informatiques peut-être), ni la joie, ni ce sentiment de bonheur quand on ouvre une boîte de gâteaux en métal chez mamie et qu’il y a bien des gâteaux dedans et pas des rouleaux de fil à coudre.

Elles n’ont aucune forme de morale (un peu comme ceux qui créent les IA en volant les données).

La conscience des IA

Ah, la conscience des IA, un sujet aussi fascinant que controversé. Beaucoup de personnes s’émerveillent déjà à l'idée d'avoir des machines conscientes, tandis que d’autres frissonnent en imaginant des robots rebelles.

Alors, les IA peuvent-elles vraiment devenir conscientes ?

Reprenons les bases. La conscience, cette capacité mystérieuse de ressentir, penser et percevoir, est encore un territoire en grande partie inexploré par les sciences. Le champ des sciences de la conscience, encore jeune, tente de cartographier ce gouffre entre matière physique et expérience subjective. On parle souvent de "conscience phénoménale", ce sentiment d'être et de ressentir, ou de "qualia", les aspects qualitatifs de nos expériences.

Il y a plusieurs théories en lice concernant comment la conscience pourrait émerger, elles sont toutes assez compliquées et aucune ne fait consensus. L'une des plus populaires, et aussi la plus simple à expliquer, ce qui m’arrange, c’est la théorie de l'espace de travail global (global workspace theory). Cette théorie propose que notre conscience émerge de l'interaction entre diverses régions spécialisées du cerveau par une sorte de "diffusion". Imaginez un grand centre de diffusion où les informations importantes sont projetées et rendues accessibles à toutes les parties du cerveau. C’est un peu comme une chaîne de télé interne diffusant une émission spéciale sur la conscience.

Pour schématiser, imaginez le cerveau comme une administration tentaculaire avec des services spécialisés travaillant chacun dans leur coin : un service pour la vision, un autre pour l’audition, et ainsi de suite. Le Global Workspace agit comme une salle de rédaction d’une chaine d’info en continu où les informations cruciales sont partagées avec tout le monde. Les services envoient leurs rapports à cette salle, mais seulement les plus pertinents sont diffusés sur Conscience24.

Conscience 24, 24h sur 24h, et de suite notre dossier du soir avant de dormir, “est-ce que vous vous souvenez de cette interaction très malaisante ? Repassons les images pendant toute la nuit”

Cette diffusion permet à d’autres services d’utiliser ces informations pour des tâches complexes, comme planifier d’aller chercher une glace alors qu’on regarde la télé.

Les IA, en particulier les modèles de langage (LLM, Large Language Models comme GPT-4), sont capables de simuler des comportements très humains : discussions sur la conscience, questionnements existentiels, etc. Mais cela signifie-t-il qu'elles sont conscientes ? La réponse n'est pas si simple.

Pour qu'une IA soit consciente, il ne suffit pas qu'elle en parle ou donne l'impression de l'être. Il faut qu'elle éprouve un état subjectif. Avoir une identité propre, voyez ça comme avoir un avis.

Les modèles actuels sont principalement des simulateurs d'agent, prédits à imiter des schémas dans les données humaines sur lesquelles ils ont été entraînés.

Ils peuvent délivrer des réponses convaincantes sur la conscience sans réellement comprendre ce qu'ils disent. A la manière de la chambre chinoise.

C’est là que le fonctionnalisme entre en scène, et vient chambouler un peu ce qui part pour être une réponse négative. Cette hypothèse soutient que ce qui fait notre expérience consciente, c’est la réalisation de certaines fonctions, indépendamment du type de matière qui les réalise, des neurones tous mous ou du silicium bien dur.

Du coup avec le fonctionnalisme si ça répond comme si ça avait une conscience, on peut dire qu’elle a une conscience. Mais le fonctionnalisme n’est qu’une forme simplifiée.

Pour une IA, au-delà de l'imitation de réponses conscientes, les scientifiques enquêtent sur la réelle possibilité d'états de conscience à terme de systèmes d'IA, en s'appuyant sur des théories scientifiques de la conscience. Mais cela reste purement spéculatif. Même si certains architectes d'algorithmes, comme les transformers et perceivers, peuvent déjà ressembler au fonctionnement de notre cerveau, il demeure actuellement incertain que cela suffise à générer une conscience authentique.

Mais le soucis de se caler sur notre fonctionnement cérébral pour déterminer s’il y a conscience ou pas c’est qu’on peut faire un système ultra simple et TUUURBO débile avec littéralement 3 neurones qui se battent en duel, avec un fonctionnement effectivement très proche du notre, dont par exemple un global workspace, mais ça ne le rend pas conscient pour ça.

La question de la conscience de l’IA dépend finalement de la réponse que l’on donne à la question de la conscience elle-même.

Impact sur notre planète

Voilà, il fallait bien y venir. La création d'IA n'est pas sans conséquence pour notre bilan CO2. L’entraînement et le fonctionnement des IA nécessitent des quantités astronomiques d'énergie. Les data centers, ces immenses fermes de serveurs, consomment autant d’électricité qu’une ville entière. Imaginez Paris éclairé par des néons et habité par des geeks en permanence.

En fait, entraîner des modèles tels que GPT-3 (l’ancien modèle donc hein) nécessite une quantité d’énergie digne de celle utilisée pour chauffer l’Alaska.

Et vous savez quoi ? Cette surconsommation énergétique, c’est la catastrophe pour notre planète, avec des empreintes carbones qui explosent les compteurs, et ça les explose de plus en plus à chaque nouvelle génération. Bref, une IA écologique, c’est MORT, c’est comme chercher une licorne qui pond des œufs d’or.

Mais l’écologie ce n’est pas le seul impact négatif sur notre environnement. Je vais parler désormais de notre environnement intellectuel, parce que si je vous dit image IA, vous pensez probablement à ces images au rendu si particulier, entre rêve et cauchemar, avec des peaux soit trop lisses soit exagérément marquées.

Art et IA

L’IA dans l’art, c’est comme l’ananas sur… la tartiflette : c’est pas juste un peu controversé, c’est carrément absurde ! L'IA elle-même se fait artiste !

Allez hop au placard les artistes, vous ne servez plus à rien, désormais c’est robot Picasso, Michel-Ange digitalisé, et bientôt Beethoven sur disquette.

Plus besoin de photographes désormais, plus besoin de chercher une photo d’illustration quand on peut en générer une !

Un des trucs les plus délirants, ce sont les IA générant des peintures, des musiques et des poèmes. Des plateformes comme DALL-E ou les GANs (Generative Adversarial Networks) produisent des œuvres d'art en un clic.

Mais chers amis, attention là, parce que c’est un terrain on ne peut plus dangereux, non seulement pour les artistes qui râlent, et pas qu’un peu, ces IA ne créant pas : elles vampirisent leurs œuvres pour en produire de nouvelles. On appelle ça de l’appropriation.

Mais cet usage de plus en plus courant délaissant les usages d’images stock ou commandées est un système qui fait courir à sa perte le monde artistique dans son entièreté, déjà pas un métier très stable financièrement, mais c’est aussi un risque pour l’IA elle-même, ce n’est pas un modèle de fonctionnement qui peut perdurer.

Les GANs, ces bêtes-là, dont le rôle est de créer de nouvelles images, s'inspirent d’images déjà existantes.

Imaginez qu’on découpe vos photos de vacances pour en faire des collages terrifiants. Sympa, hein ? Des artistes légitimes voient leur travail pillé, échantillonné et resservi sans leur consentement ni rémunération.

C'est un peu comme si on volait votre tartiflette, on la mangeait, on la vomis et on utilise ce vomi pour en faire une autre en la passant au micro-ondes et qu’on vous dise “vous voyez pas besoin que tu cuisines !”. Beurk.

Conclusion

l'Intelligence Artificielle est un outil formidable sur le papier, bourré de potentiel, mais pour le moment c’est rempli de paradoxes et de pièges.

Elle peut transformer nos vies, mais doit être utilisée de manière avisée et surtout éthique.

Mais est-ce seulement possible de faire une IA rentable avec des données acquises légalement ?

Pas certain. (même relativement certain que non, en fait)

Et aussi, il est crucial de rester attentifs aux conséquences écologiques, sociales et humaines de sa croissance effrénée.

Alors oui, l’IA peut résoudre des équations complexes, corriger votre code, diagnostiquer des maladies en un clin d’œil d'électron.

Mais soyons clairs, non seulement elle ne remplace en rien notre bon vieux bon sens humain, notre créativité débridée, et cette chaleur que seuls nous, les humains, pouvons offrir, mais en plus à l’heure actuelle, toutes les IA sur le marché sont basées sur le vol pur et simple.

“Vaut mieux demander pardon que la permission” a toujours été le mot d’ordre des startups, mais jamais elles n’avaient atteint ce niveau de braquage de données. (et le mot est faible)

Donc sachez que lorsque vous faites appel à cette technologie, vous êtes receleur du plus grand vol de propriété intellectuelle de l’histoire de l’humanité, avec en prime, des centrales nucléaires entières dédiées à faire tourner ces coffres remplis de ces trésors pillés.

Vous pensez que j'exagère ? Aux USA, Microsoft va d’ailleurs rallumer une centrale, celle de Three Mile Island, qui était éteinte depuis 1979 suite à une catastrophe nucléaire avec fusion du cœur d’un des réacteurs… OUI on en est là. Prochaine étape, on rallume Tchernobyl, allez, n’arrêtons pas la course à la technologie pour si peu !

Je vais quand même terminer par une note plus positive : la technologie est là, elle a fait ses preuves, et ça serait inimaginable de ne pas en tirer profit.

Je ne fustige pas la technologie ici mais surtout l’usage en amont et ses conséquences en aval.

Mais ce qu’on ne pourra changer c’est que le prototype a eu un bon essai, le test est réussi.

Il serait donc temps de dépasser cette phase de test, en commençant par détruire ces prototypes existants à grand coup de régulation sur le droit d’auteur appliqué dans leur gueule (ou juste faire respecter le droit en place, hein^^), et construire des modèles peut-être plus chers à créer, avec des buts plus dédiés (pour le code, le médical etc), mais où personne n’est lésé.

Forcément leur usage sera aussi plus cher, puisque au prix réel des données utilisées, probablement hors de portée de la plupart d’entre nous, (des outils réservés aux professionnels de santé ?) et peut-être qu’on s'apercevra qu’il est finalement plus rentable et plus qualitatif de faire appel à des humains pour la plupart des métiers de création sur lesquelles beaucoup de patrons sont en train de rédiger les lettres de licenciement.

Je ne vous dis pas ici quoi penser sur l’IA, je ne vous juge pas si vous l’utilisez, je l’utilise moi-même pour le code et ponctuellement pour vaincre le syndrome de la page blanche.

Je vous donne les faits, maintenant c’est vous qui décidez de la valeur que vous accordez au droit d’auteur, à l’écologie, à la part de l’humanité que vous souhaitez voir apparaître dans les créations que vous consommez.

L’utiliser, en payant ou pas, c’est légitimer la situation en place.

Pire que ça, c’est y contribuer : Un utilisateur gratuit a quand même une forme de valeur, non seulement auprès des investisseurs, mais comme on l’a vu, vous contribuez à l’amélioration de l’IA. Vous travaillez donc gratuitement vous aussi pour ces entreprises.

Finalement, on peut dire que l’IA vole tout le monde, y compris vous.